En un mundo web dominado por por los vídeos, se hace necesario ayudar en la creación de los mismos, aunque solo tengamos una imagen de referencia.

Eso es en lo que ha estado trabajando Google, en permitir que la red neuronal DeepMind pueda crear videos cortos a partir de un solo marco de imagen.

Este modelo de inteligencia artificial, llamado «Transframer«, genera texto en función de indicaciones parciales, y ahora es capaz de generar videos de 30 segundos a partir de una sola imagen.

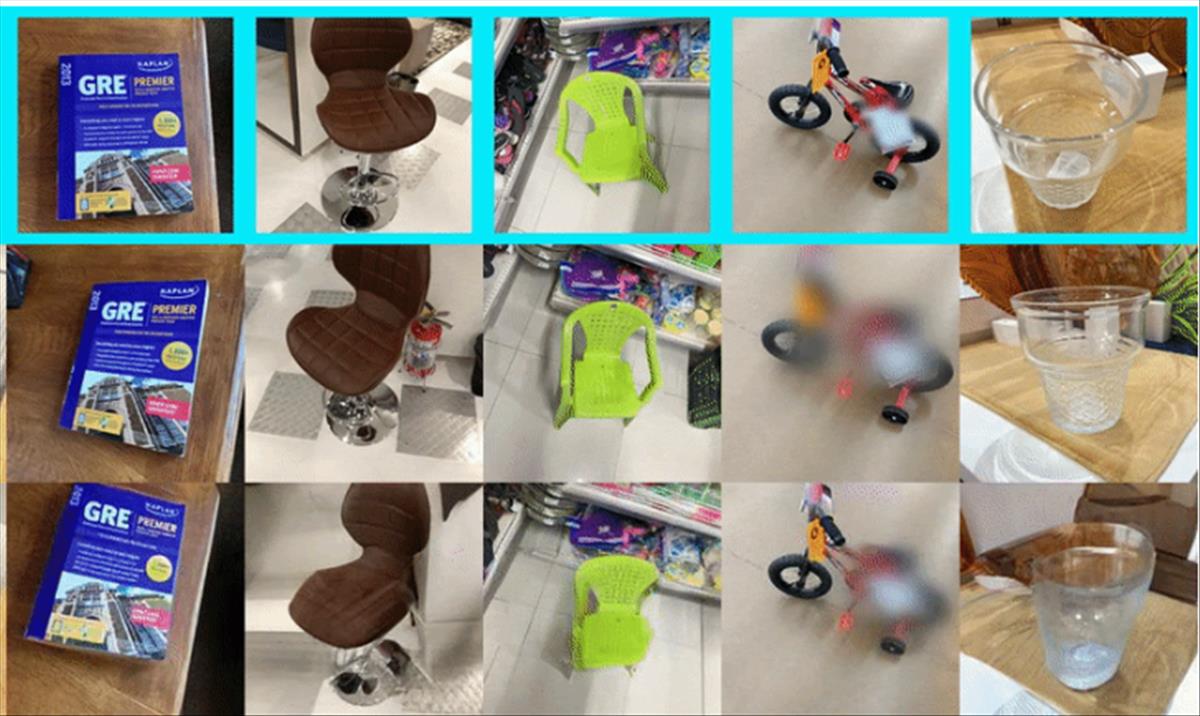

La IA adivina el entorno de las imágenes usando imágenes de contexto, de forma que puede mostrar cómo es el contorno de un mueble sin verlo realmente. Lo que hace es imaginar un objeto real desde cualquier ángulo.

Es fácil imaginar cómo lo hace. Si a un programa le doy miles de imágenes de una silla desde todos los ángulos posibles, y después le mando la foto de una silla de frente, el programa puede imaginar el resto gracias al entrenamiento realizado anteriormente.

En la demostración se nota la percepción de profundidad artificial y la perspectiva, lo que ayuda a imaginar cómo pueden mejorar los videojuegos con algo así, no solamente la creación de vídeos para las redes sociales.

Transframer is a general-purpose generative framework that can handle many image and video tasks in a probabilistic setting. New work shows it excels in video prediction and view synthesis, and can generate 30s videos from a single image: https://t.co/wX3nrrYEEa 1/ pic.twitter.com/gQk6f9nZyg

— DeepMind (@DeepMind) August 15, 2022

Si podemos crear imágenes realistas con DALL-E, y a partir de ella podemos crear vídeos, estamos a un paso de crear vídeos de forma automática a partir de un solo mensaje de texto.