ChatGPT puede usarse para una enorme cantidad de cosas. Podemos hacer poemas, crear textos, generar HTML, corregir errores de programación, destacar palabras en negrita, resumir trabajos… la herramienta es buena, pero puede usarse en el lado oscuro de la fuerza, intentando engañar a profesores y académicos con trabajos generados de forma automática.

Tal y como comenté recientemente: mala cosa si un texto de un alumno y un texto de una IA se parecen mucho. El profesorado debe enseñar a digerir la información, no a transmitirla de la misma forma que hace la Wikipedia. No tiene sentido pedir trabajos académicos de la misma forma que lo hacíamos antes de la existencia de Internet, pero eso es otra cosa que debe ser tratada por expertos del sector.

El caso es que ahora ya hay las primeras prohibiciones de ChatGPT. Por un lado tenemos escuelas de New York prohibiendo la herramienta, y ahora tenemos a una de las mayores conferencias sobre Inteligencia Artificial.

Así es, la Conferencia Internacional sobre Aprendizaje Automático anunció la política a principios de esta semana. Dijo:

[…] los documentos que incluyen texto generado a partir de un modelo de lenguaje a gran escala como ChatGPT están prohibidos, a menos que el texto producido se presente como parte del análisis experimental del artículo.

Esto muestra una vez más el miedo que se genera en el mundo de la creación de artículos. ChatGPT podrá ser prohibido, pero no será posible hacerlo de forma adecuada si no se identifica correctamente.

Diferenciar un texto creado por ChatGPT a uno creado por un ser humano no es una tarea fácil. Herramientas como GPTZero lo intentan, pero ya me ha dado falsos positivos y falsos negativos, por lo que no es en ebsoluto fiable.

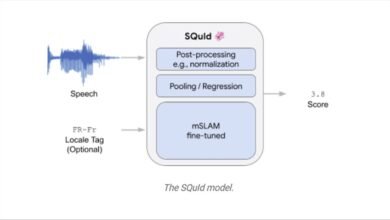

Dicen que dentro de poco habrá códigos dentro de los textos generados por IA para que otras herramientas lo identifiquen como «artificial», pero es tan sencillo de burlar como el usar una herramienta OCR y capturar el texto dentro de una imagen.

Será interesante analizar la evolución de este tipo de herramientas, así como los intentos de la humanidad por bloquearlas.