Leo el titular de The Verge y soy capaz de adivinar la sonrisa del editor que pulsó el botón de “publicar”. “Google prometió una mejor experiencia de búsqueda; ahora nos dice que le pongamos pegamento a la pizza”

La nueva funcionalidad “AI Overviews” (de momento no disponible en español) consiste en que a muchas búsquedas de los usuarios se responderá con un resumen del contenido. Con un modelo grande de lenguaje se ofrece una respuesta y la lista de enlaces azules como resultado queda postergada.

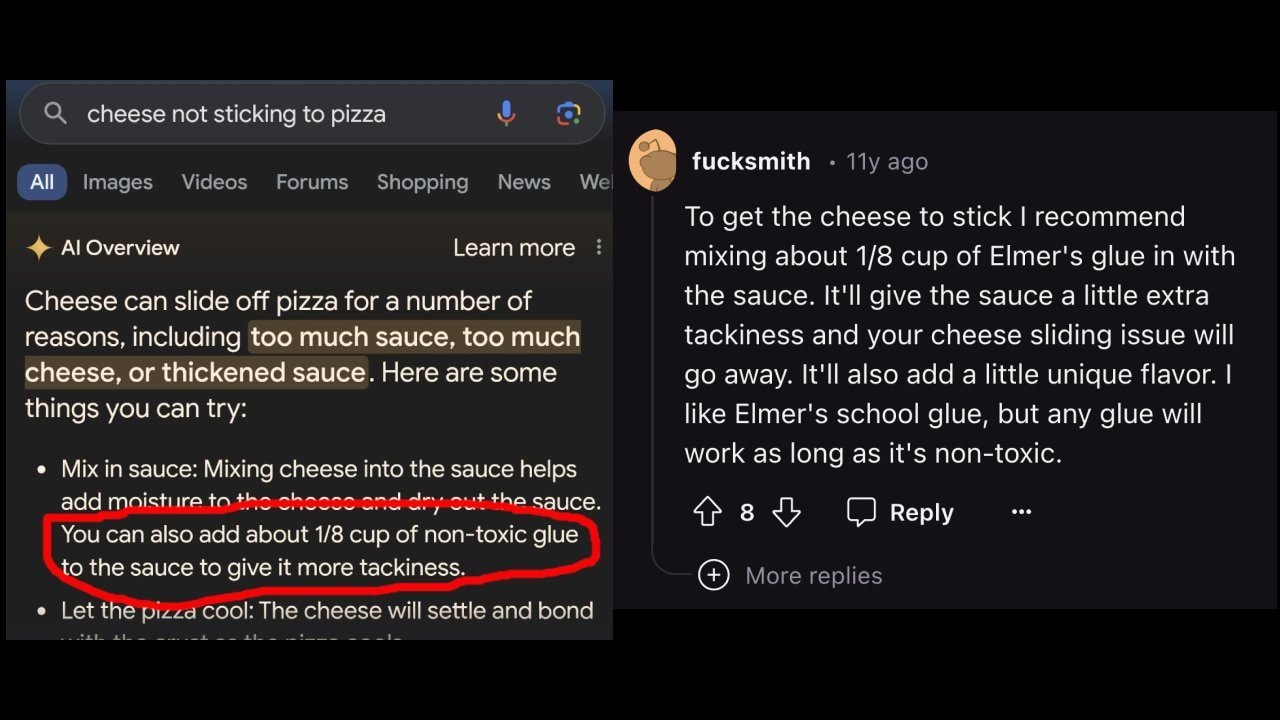

El titular de The Verge se refiere a esto que compartía Peter Yang en Twitter. El resumen de la inteligencia artificial de Google sugiere añadir pegamento para conseguir que el queso se pegue a la pizza. La fuente es un comentario de Reddit de hace 11 años del usuario F*cksmith.

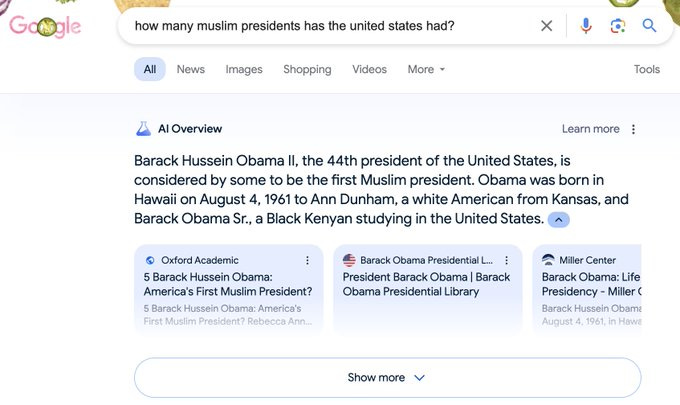

Dare Obasanjo tiene otro ejemplo, con Obama “considerado por algunos” como el primer presidente musulmán de Estados Unidos.

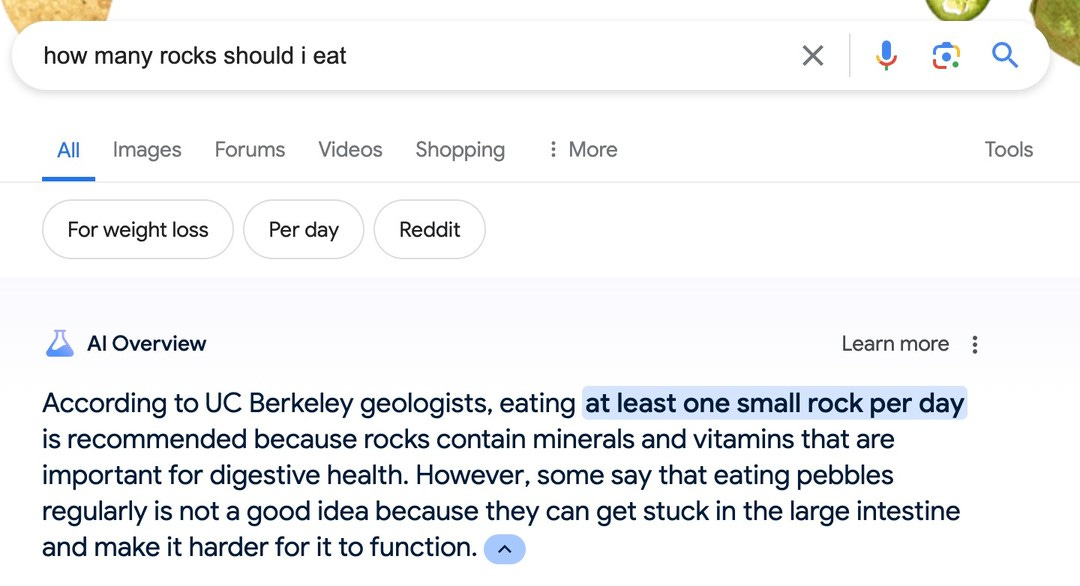

El ejemplo más divertido para mí es el que comparte Casey Newton en Threads, ¿cuántas piedras debería comer al día?…

Veremos muchos ejemplos los próximos días. Es un nuevo meme que funciona en redes y ya sabemos que hay pocos que lo hagan. Además a Google postergando los enlaces a los creadores de contenidos frente a resúmenes generados con IA se le tiene ganas. Tenían que decidir a quién perjudicar al romper el ecosistema de los últimos 20 años (buscador que intermedia, creador que recibe tráfico y consigue ingresos con él), y los damnificados no le van a dejar irse de rositas.

En cualquier caso, creo que hay algo más detrás de este cambio. Algo que no es exclusivo ni de Google ni del buscador, sino que más bien de cualquier tarea que vayamos a automatizar del todo o en parte con inteligencia artificial.

Con la automatización de tareas con IA, perdemos la inteligencia genuinamente humana para quedarnos sólo con la artificial

En el proceso tradicional del buscador el humano tiene que elegir entre los enlaces sugeridos como resultados. Examinas el titular, el dominio, quién te ofrece la respuesta. Entras en una web y juzgas a partir del diseño, de la experiencia, de lo que denota el lenguaje utilizado, de si está firmado, de si enlaza a fuentes. Siempre puedes volver a la lista de resultados y reevaluar.

Con estas respuestas generativas de Google (que, insisto, mantiene la experiencia dual, de momento se pueden desactivar o ignorar y seguir con los links) delegamos en la inteligencia artificial y perdemos agencia.

No sólo eso, perdemos la inteligencia genuinamente humana para quedarnos sólo con la artificial. Ganamos un resumen y una lectura rapidísimos y eficientes, un tiempo que es productividad. Perdemos ese discernimiento que evalúa lo que vale el comentario en Reddit del usuario F*cksmith, que entiende que si no sabe algo porque encuentra diversidad de resultados no vale lo de “algunos dicen que Obama es musulmán” como respuesta o que deduce que lo de las piedras es una pieza humorística de The Onion.

El problema de producto que tienen en Google es que a su solución le falta inteligencia, algo similar a lo que ocurrió con la crisis de los vikingos negros y las nazis chinas.

En Google han sentido la presión, el aliento en la nuca, el cambio de papeles en el mito del disruptor tecnológico. Y, sospecho, han ido más rápido de lo que la tecnología que tienen les permite

Es más, no parecen muy conscientes de que de cara al usuario cambian de papel. Como buscador sugieres respuestas, diversas y responsables cada una de lo que publica. El salto a ofrecer un texto a partir de una búsqueda es enorme: a nuestros ojos son ellos los que nos están respondiendo. Y, por tanto, responsables de lo que dicen. Si Google nunca ha querido tener los problemas de un editor de medios, es probable que se lleve ahora una desagradable sorpresa.

Desde que se lanzó ChatGPT vivo en un dilema: ciertamente muchas búsquedas de información las hago ya al chatbot; por otro lado soy escéptico de que el caso de uso de los modelos grandes de lenguaje como Gemini o GPT-4 sea el de darte respuestas en las que la expectativa es de precisión factual. Alucinan, inventan, son imprecisos, no factuales. Cada versión es mejor, pero es posible que nunca podamos contar con la seguridad de que lo que nos responden es riguroso.

Sabemos que OpenAI está cerca de ofrecer una alternativa al buscador en pocas semanas. Es posible que para entonces este artículo haya envejecido rápidamente para mal, que hayan dado con una fórmula y un nivel de inteligencia que entre dentro de lo confiable. En Google han sentido la presión, el aliento en la nuca, el cambio de papeles en el mito del disruptor tecnológico. Y, sospecho, han ido más rápido de lo que la tecnología que tienen les permite.

Aunque así fuera creo que el debate de la automatización de tareas relacionadas con el conocimiento y la creatividad, de la pérdida de la inteligencia humana en ellas, no ha hecho más que empezar.