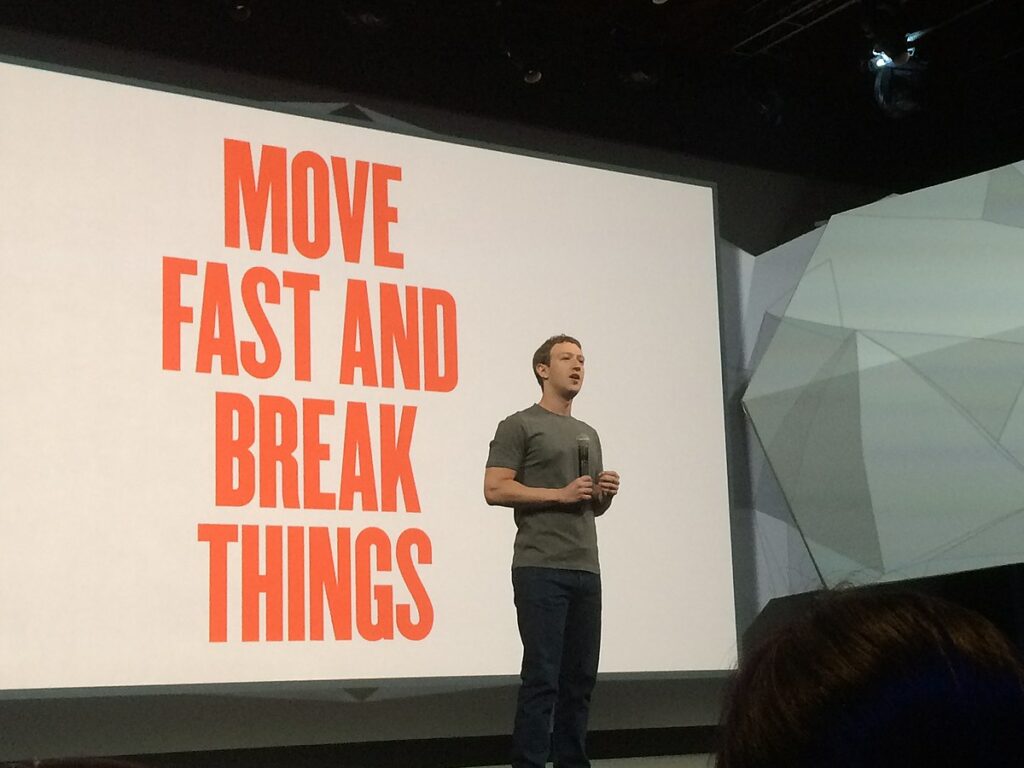

La frase original fue acuñada por Mark Zuckerberg en los orígenes de Facebook, y hacía referencia a una cultura en la que predominaba la excelencia técnica y la capacidad de convertir cualquier idea en código ejecutable en muy poco tiempo, un atributo de funcionamiento interno, en principio, muy positivo para cualquier compañía.

De aquella época, que llevó a que ese «move fast and break things» pasase de ser una simple filosofía interna de desarrollo a convertirse en lema y después en meme, hasta que un Zuckerberg ya totalmente abrumado por los escándalos decidió ponerle fin, surge un estilo irresponsable y una forma de hacer las cosas que, sin duda, ha triunfado en Silicon Valley y en muchos otros sitios, con todo lo que ello conlleva.

Una moda que supone que las compañías pongan en el mercado productos muy escasamente probados, o que incluso poseen problemas ya identificados y potencialmente peligrosos. Lo vimos claramente cuando un vehículo autónomo de una Uber obsesionada por tener a punto un sistema de conducción autónoma que creía esencial para el futuro de la compañía mató a una persona que cruzaba imprudentemente una calle, porque seleccionó a una persona completamente irresponsable como conductor de seguridad de un automóvil provisto con un software experimental lleno de bugs. Como resultado de aquel accidente, Uber interrumpió sus pruebas con vehículos autónomos hasta diciembre de ese mismo año, para finalmente en 2020 abandonar su desarrollo.

Ahora, y en este mismo entorno, vemos otro claro ejemplo de irresponsabilidad: la retirada de los vehículos autónomos de Cruise, la compañía propiedad de GM, fue debida a un accidente en el que una mujer fue atropellada y arrastrada durante varios metros, tras lo cual la compañía trató de ocultar los detalles del accidente. Ahora, un análisis de materiales internos de la compañía revela que la compañía era perfectamente consciente de que sus algoritmos tenían problemas reconociendo baches y niños, y que a pesar de ello, los mantuvo circulando por las calles.

La conducción autónoma es un horizonte enormemente interesante de cara al futuro y está planteada para ser mucho más segura que la conducción humana. Pero poner en la calle productos que no han sido suficientemente probados para no perjudicar un despliegue que está costando mucho dinero a la compañía es no solo irresponsable, sino además, un indicador de que alguien tiene sus prioridades espantosamente mal ubicadas.

Estamos en lo mismo: muévete rápido, y si rompes cosas, ya veremos lo que hacemos. El problema no es la tecnología, cuyo desarrollo va a seguir avanzando, sino la irresponsabilidad de quienes ponen en el mercado productos basados en esa tecnología sin plantear los potenciales problemas que pueden generar. Da lo mismo que hablemos de redes sociales, de conducción autónoma o de inteligencia artificial: más que tratar de regular el desarrollo de la tecnología, hay que plantearse cómo diablos encarecer el precio de la irresponsabilidad, y evitar que se pongan productos en el mercado que no hayan pasado exhaustivas fases de sandboxing y redteaming en todos los sentidos. El problema no está en la tecnología, sino en los que la gestionan.